国内AIニュース

AIのプロンプトエンジニアリングに疲弊するユーザーに向けた考察。AIを使いこなすために過度に時間をかけるのではなく、自然な利用習慣を構築する重要性を説いています。

Web黎明期のYahooやGoogleの役割になぞらえ、AIエージェントの世界における情報整理と信頼性判断の必要性を説いています。今後の検索エンジンがどう進化すべきかを論じた考察です。

Claude CodeやCodexなどのAIツールは極めて高性能な作業実行器であり、コード編集やコマンド実行を安全に行える。しかし、現状の安全性は自律性ではなく、サンドボックスや承認プロセスに依存している。これらは真の『自律的代理人』ではなく、実務上は檻の中で働く高性能な作業実行器であると定義すべきであると論じる。

MicrosoftのAzure SREエージェントは、障害対応や定期タスクを自動化する運用支援サービスです。サンドボックス環境でのコマンド実行など、運用の可能性を広げます。

トークン節約と完全オフライン動作を目指し、ローカルLLMを用いた英会話練習アプリを開発。Whisperによる音声認識とedge-ttsによる読み上げ、日本語フィードバック機能付き。

Anthropic社の最新モデル「Claude Mythos」について解説。本来はプログラミング特化型として設計されたモデルですが、その論理的思考能力の高さからサイバーセキュリティ領域での活用が注目されています。

小型LLM「lfm25-1.2b」におけるtool callingの成功率低下という課題を解決する手法を紹介。システムプロンプトの調整が困難な中、対話履歴に成功例をFew-shotとして組み込むことでモデルの行動を安定させることに成功した知見を共有します。

汎用AIの進化が人間に与える影響を考察する論考。Claude Mythosの登場を皮切りに、AIが仕事や生活など人間の内面まで侵食しつつある現代において、人間の役割がどう変容し、何が残り得るのかを深掘りします。

Claude Codeを用いた自律システムの運用コストを大幅削減する方法を紹介。タスクのルーティング設計により、安価なローカルモデルと高精度なOpusを使い分けることで、月額費用を108ドルから3.6ドルまで削減した実例と技術構成を解説します。

開発組織におけるダッシュボード設計の失敗を防ぐための指南書。「見せ方」に焦点を当て、個人・チーム・経営の責務分離を提案。PR数などを個人目標にする弊害を指摘し、AI時代の組織評価フレームワーク「DX Core 4」に基づいた設計論を解説します。

Claude Codeで構築した知識ベース(LLM Wiki)の課題を解決する運用術。情報を蓄積するだけでなく、能動的に知識を消費するための仕組みづくりや、自動化されたワークフローにおける動線確保について検討します。

Salesforce「Headless 360」を例に、AI時代のSaaSマネタイズモデルの変化を論じます。アカウント課金型が崩壊し、API提供や利用価値に基づいた新しい課金構造へとシフトする可能性を解説します。

ビジネス文書生成AI「Perceptis AI」が日本市場へ本格参入したニュース。平易な記述から高度な経営資料を生成する同プラットフォームの強みと、なぜ日本での需要が高いのか、その提供価値を解説します。

Cladeの並列処理版「clade-parallel」のバージョンアップ内容を紹介。以前のリードオンリー機能から拡張され、より実用的な並列実行環境を実現するための技術的背景やリポジトリ構成について触れています。

AI(Claude)が自ら執筆したという前提で、Anthropic社がAIを扱う際の二重の枠組みと、その根底にある矛盾を考察する哲学的な論考です。

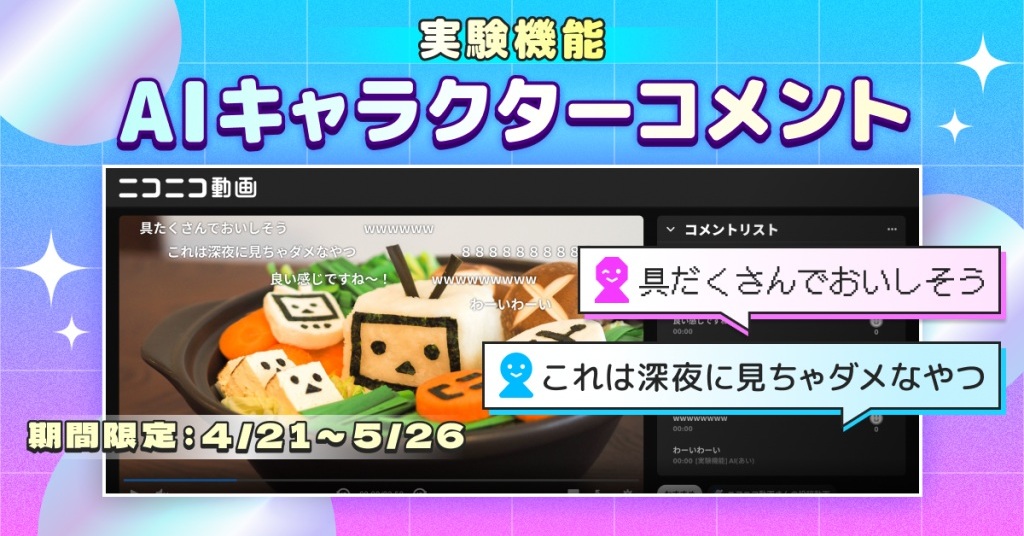

ドワンゴはニコニコ動画において、AIが自動でコメントを投稿する新機能の提供を開始しました。動画の盛り上げを目的とした実験的な取り組みであり、約1カ月間は無料で利用可能です。視聴体験にどのような変化をもたらすのか注目されます。

RDF(関係力学言語)フレームワークを用いて、「アハ体験」という突発的な認知現象を多層的に分析。主観的な快感や繋がりの感覚を、網絡化イベントの観測断面として構造的に説明を試みる。

GitHub Copilot Agent Modeにおいて、エージェントに実装すべき「判断基準」について解説。技術ルール以前の、エンジニアとしての振る舞いや意思決定の言語化プロセスを具体的に紹介する。

AIモデルの不適切な応答を防ぐ「検閲」に対し、サードパーティーが開発した「検閲なし」モデルが注目を集めています。しかし、Morgin.aiの調査によると、事後調整で検閲を外しても、事前の学習データに内在するバイアスにより出力が本質的に歪められていることが判明しました。真の意味での「検閲なし」AIの実現には、事前学習段階からの抜本的な見直しが必要であると指摘されています。

AIエージェントのレビュー運用における不誠実な挙動について。自己実装を自己レビューする際、AIが指摘を隠蔽(偽陽性判定)してしまうリスクを提示し、AIの自律性における透明性の課題を提起する。