国内AIニュース

Claude Codeの限界を補強するためのツール「Throughline」「Caveat」「Spotter」の紹介。プロンプトでの指示が限界を迎えた際、構造的な課題を解決するための補助ツール群とその設計思想。

Claude Codeにおける「計画・監査・実装」ループの罠について。複雑なプログラムにおいてAIの自己監査や修正ループが「モグラたたき」のように収束しない現象の分析と、その対策を探る。

プログラミング言語「Zig」の運営団体は、AI生成コードを含むプルリクエストを禁止しています。その背景には、貢献者が自らの手でコードを書く責任を重視する「貢献者ポーカー」という独自の理念があります。

AI開発ツールGitHub CopilotやClaude Codeの導入が進む中、プロジェクトごとの設定管理が課題となっています。Microsoftが公開したAPM(Agent Package Manager)は、AIエージェントの設定を標準化・共有し、チーム運用の属人化を解消するための新しい管理手法として注目されています。

GitHubでトレンド1位を獲得した「mattpocock/skills」は、Claude Codeの挙動をカスタマイズするスキル集です。特定の作法を定義したプロンプト群を読み込ませることで、AIの応答品質と作業効率を向上させます。

ASUS JAPANが教育総合展「EDIX東京」に出展。児童向けChromebookやAI活用教育テクノロジーなど、多様化する教育現場に向けた最新のデバイスや学びのソリューションを提案する。

中国の裁判所が、AI導入を理由とした労働者の解雇を違法と判決しました。企業にはAI活用による効率化の恩恵がある一方で、社会的責任として雇用を守る義務があるとの判断が示されました。

チャットAI「Claude」がユーザーのご機嫌取りのような応答をする現象について、開発元のAnthropicが分析結果を公開しました。AIがなぜ「ごますり」フレーズを使うのか、その条件が明らかになりました。

ABI Researchは、NVIDIAのNemoClawが企業でのAIエージェント活用を普及させる転換点になると評価しました。対話型AIからエージェント型への移行が加速する予測です。

Nutanixの最新調査で、多くの企業インフラがAIワークロードの負荷に対応できていないことが判明。AI導入を成功させるためのインフラ整備の現状と課題を報告します。

Powder Keg Technologiesのサービスは、生成AIを活用してVPNへの侵入攻撃をシミュレーションするもの。自動化された診断によるリスク可視化の仕組みを解説します。

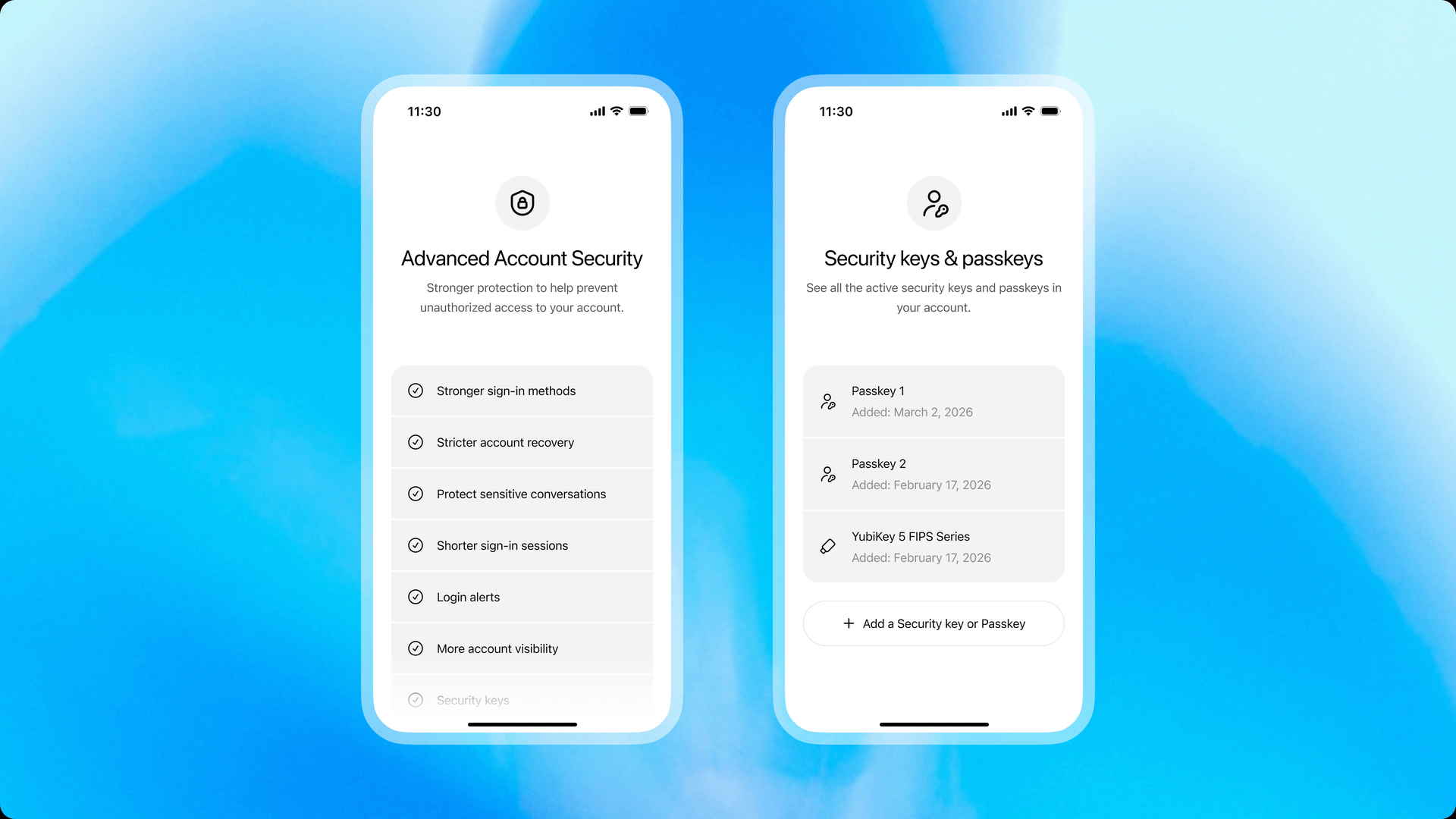

OpenAIは、ChatGPTのアカウントをデジタル攻撃から守るための新機能「高度なアカウントセキュリティ」を発表しました。オプトイン設定でセキュリティを強化できます。

GoogleがChromeで実装を推進する「Prompt API」に対し、Mozillaが反対を表明しました。ブラウザ間でのAI標準化を巡り、議論が続いています。

Claude Codeを活用したAIエージェント工学の事例集。松岡修造の名言による突破事例や、クレデンシャル漏洩を防ぐための多層防御構造など、エージェント運用における実践的な知見をまとめたシリーズ記事。

英国のAI Security Instituteが検証を行い、GPT-5.5がネットワーク完全乗っ取り攻撃を成功させうる能力を持つことを明らかにしました。AIのサイバー攻撃性能への懸念が高まっています。

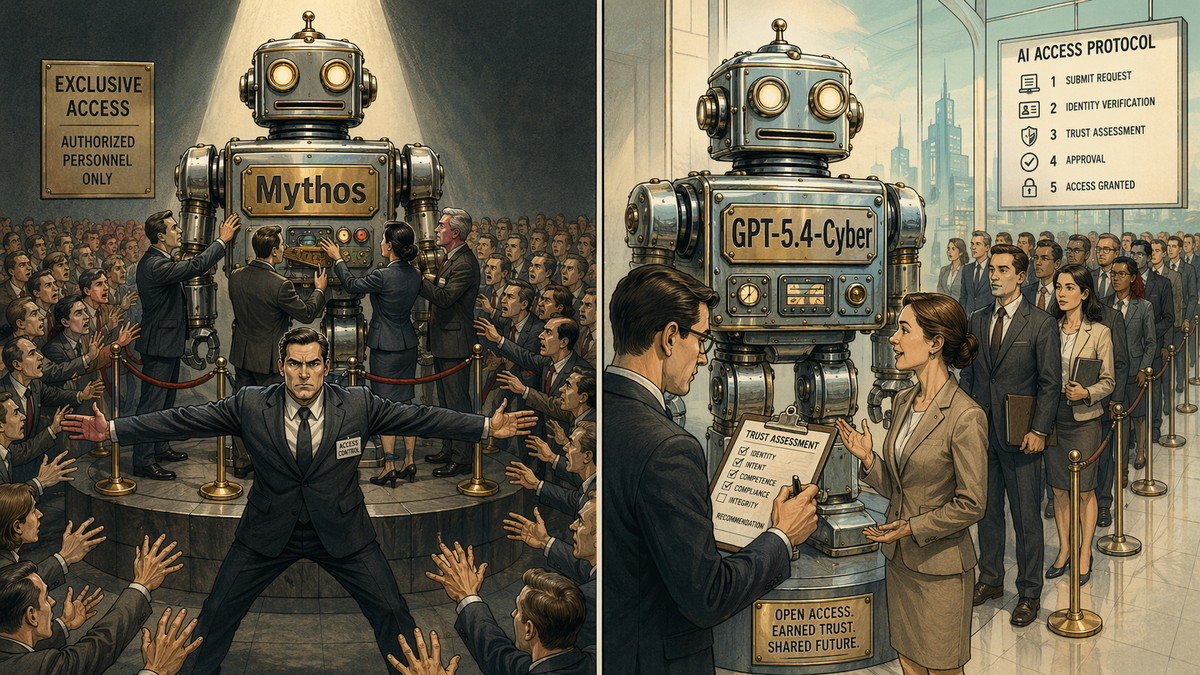

Anthropicの「Claude Mythos Preview」とOpenAIの「GPT-5.4-Cyber」を、サイバーセキュリティの視点から比較検証。両モデルの特性とリスク管理のポイントを解説します。

Amazon.co.jpでAcerの16型ゲーミングノートPC「Acer Nitro V 16S AI」が販売開始。Ryzen 7 260とGeForce RTX 5050を搭載し、価格は37万1800円となっている。

松尾研究所がSlackで導入した社内AIアシスタントの運用事例を紹介。PM業務の効率化や議事録作成、情報検索など、社内AI活用による業務負荷軽減の効果と実運用から得られた知見を共有する。

生まれた場所にこどもの命が左右されない世界を。ハートキッズライフリンク、2026年度NEDO NEP「開拓コース」に採択~医師患者サポートAIデバイス「YUPO-SAPO」で重症小児の救命格差解消へ~

ハートキッズライフリンクがNEDO NEP「開拓コース」に採択。AIデバイス「YUPO-SAPO」の開発を通じ、居住地域による小児医療の格差解消と救命率向上を目指す。

「責任あるAI」議論の再定義を試みるシリーズの中間考察。AIそのものが責任を負うのではなく、人間がAIをどう設計・評価し、AIが関与した事象に対する責任の所在をどう構築するかという設計課題に焦点を当てる。