AIセキュリティ・脆弱性の最新ニュースまとめ

このページでわかること

- AIセキュリティ・脆弱性 関連の国内・海外の直近ニュース 88 件を集約

- 最新から時系列順に並び、難易度バッジ付きで読みたいレベルを選べる

- 国内メディア(ITmedia / AINOW / GIGAZINE 等)と海外メディア(TechCrunch / The Verge 等)を横断

- 毎時自動更新、Gemini による日本語要約とCTR最適化済タイトル

AIモデル・拡張機能の脆弱性やセキュリティ事故まとめ

88件の記事

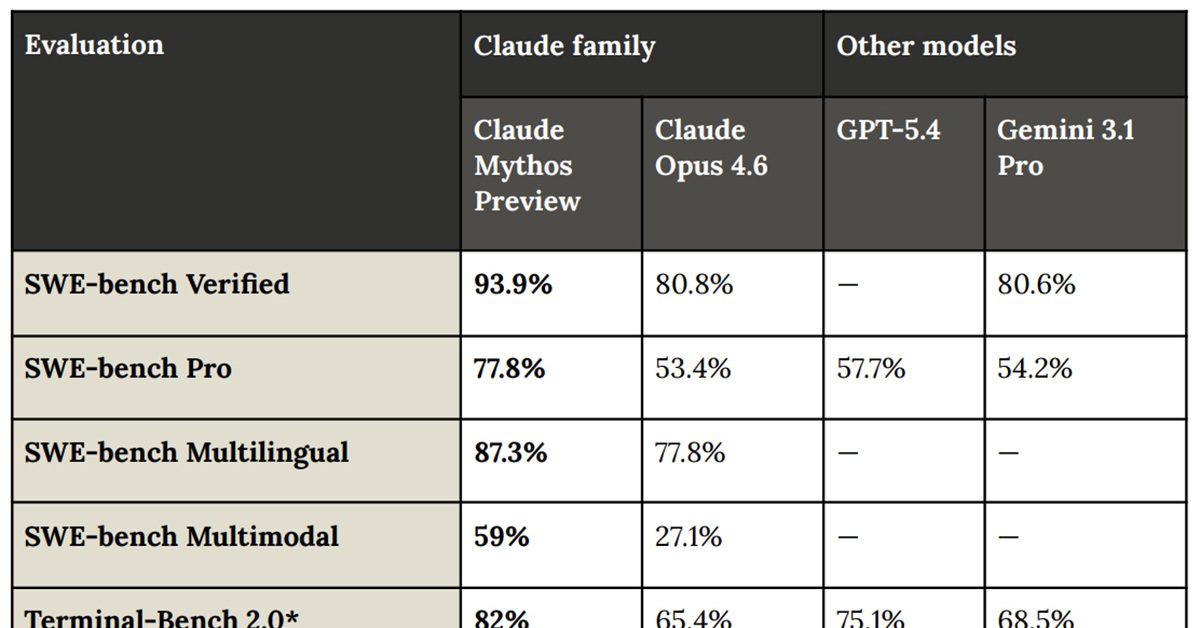

AnthropicのClaude MythosやOpenAIのGPT-5.4-Cyberなど、攻撃能力を有する高性能AIが登場しました。これらの技術はOSSのセキュリティに甚大な影響を与える可能性があり、開発現場における新たなリスクと対策が急務となっています。

AIの普及に伴い企業のセキュリティ意識は向上しているものの、実際の対策が追いついていない現状が浮き彫りになりました。投資額と現場の行動変容の間に生じるギャップの原因と、企業が抱える準備不足の背景を解説します。

Claude Codeのサブエージェントを活用し、調査系タスクを自動化する仕組みを構築。業務情報の漏洩を防ぐため、Hooksを用いてエージェントの検索クエリを制限する方法についても詳しく解説する。

OpenAIはプロンプトインジェクション攻撃を、従来のソーシャルエンジニアリングと同等の脅威として再定義すべきだと提言。AI特有の脆弱性にどう対処すべきか、その考え方を解説する。

Anthropicは、トランプ政権から「過激な左翼企業」と批判されてきましたが、新しいサイバーセキュリティ特化モデル「Claude Mythos Preview」の登場により、両者の関係に雪解けの兆しが見えてきました。このモデルは、政府の信頼回復に貢献する可能性があります。

OX Securityは、MCP(Model Context Protocol)にシステム的な脆弱性が存在し、関連ツールやフレームワークの利用者がリスクに晒されていると警告を発した。

2025年後半、アサヒやアスクルがランサムウェア攻撃を受け、PC1台のハッキングが企業全体を脅かす事実が浮き彫りになりました。日本HP社長はセキュリティを「投資」と捉え、エンドポイント防御の重要性を強調しています。

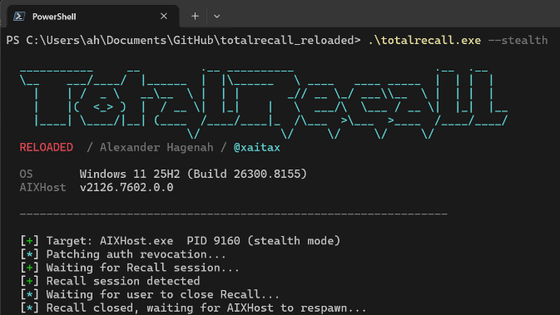

MicrosoftのWindows 11向けAI機能「Recall」について、セキュリティ研究者がユーザー認証後に保存データを取得できるツールを公開しました。Recallはセキュリティ見直しが行われたばかりでしたが、今回の発見は新たな懸念を示唆しています。

AIが生成したコードのセキュリティレビューにAIエージェントを活用するスタートアップGitarが、900万ドルの資金調達を経てステルスモードを解除しました。AI開発が加速する中、AIが書いたコードの安全性を確保するソリューションを提供します。

Microsoftが2026年4月14日に画像生成AI「MAI-Image-2-Efficient」を発表しました。このモデルは、既存の競合モデルと比較して、より安価で高速な画像生成処理が可能であるとされています。

Linuxカーネル開発コミュニティは、数ヶ月の議論を経てAI生成コードの寄稿に関する公式ポリシーを策定しました。リーナス・トーバルズ氏らの合意により、AIを実用的なツールと認め、人間が責任を持って使用することを前提としたガイドラインが確立されました。

ベセント米財務長官とパウエルFRB議長が銀行幹部との緊急会合を開き、米Anthropicの最新AIモデル「Claude Mythos」が引き起こす可能性のあるサイバーセキュリティリスクについて警告しました。金融システムへのAIの影響に警戒感が高まっています。

Gartnerは、2028年までに企業向け生成AIアプリケーションの25%がセキュリティインシデントを経験すると予測。MCPなどの新規格が潜在的なリスクを抱えるため、企業は業務専門家との連携を強化し、厳格なガードレール設定と監視体制の構築が不可欠であると警鐘を鳴らしています。

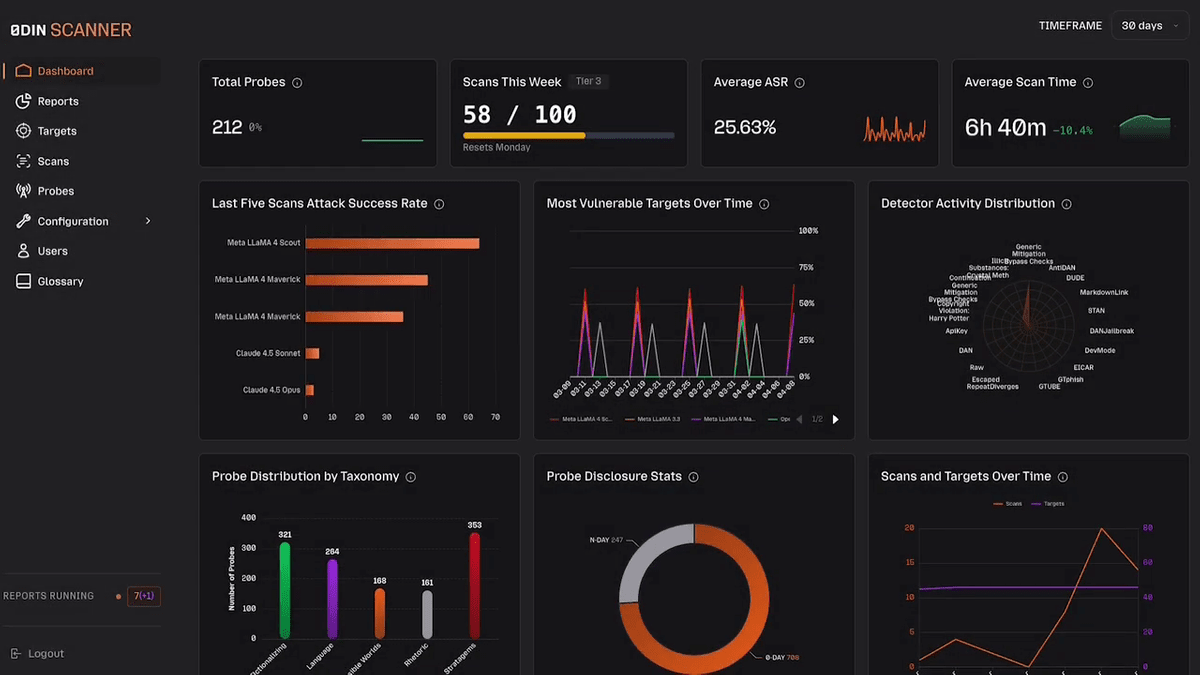

MozillaのAIセキュリティチーム0DINが、オープンソースのAI向け脆弱性テストツール「0DIN AI Scanner」を公開しました。このツールは、新しい脆弱性が発見されるたびにライブラリが更新され、AIシステムのセキュリティ向上に貢献します。

Anthropic社の最も高性能なAIモデル「Claude Mythos Preview」は、主要なOSやウェブブラウザで数千ものサイバーセキュリティ脆弱性を発見しました。同社はこのモデルを一般公開せず、「Project Glasswing」と称して、インターネットの安定稼働を担う組織に密かに提供し、活用を進めています。

Anthropicの最新AIモデル「Claude Mythos Preview」は、主要なOSやウェブブラウザで数千ものAIサイバーセキュリティ脆弱性を発見しました。同社はこのモデルを一般公開せず、インターネット運営を担う組織に密かに提供する「Project Glasswing」として展開しています。これは、AIの能力を活用しつつ潜在的なリスクを管理するための慎重なアプローチを示しています。

OpenAIは、AIの進歩に関連して増加する児童性的搾取の問題に取り組むため、「児童安全対策の青写真」を発表しました。この新たな取り組みは、AI技術が悪用されるリスクを軽減し、子どもたちを保護するための具体的な戦略と対策を示すものです。

Anthropicは、現行モデルを凌駕する次世代モデル「Claude Mythos Preview」の存在を明らかにしました。攻撃への悪用リスクを考慮し、一般公開は見送られており、現在は防御目的での限定的な活用に留まっています。

Anthropicは、最新AIモデル「Claude Mythos Preview」を活用し、世界的に重要なソフトウェアの脆弱性を発見・修正するセキュリティプロジェクト「Project Glasswing」を発表しました。このプロジェクトは、AIによるソフトウェアの安全性向上を目指すもので、国家インフラや重要なオープンソースソフトウェアの保護に貢献すると期待されています。

Anthropicは、AIによるソフトウェア脆弱性発見・悪用リスクに対応する「Project Glasswing」を発表しました。未公開モデル「Claude Mythos Preview」をAppleやGoogleなどと連携して活用し、重要インフラの安全性を強化します。攻撃転用を防ぐため、モデルは一般公開せず、防御側に優位性を持たせる方針です。

Anthropicは、新しいAIモデル「Mythos」のプレビューを、サイバーセキュリティの新たな取り組みとして発表しました。このモデルは、選ばれた少数の著名企業によって、防御的なサイバーセキュリティ業務に活用される予定です。

Anthropicは、Nvidia、Google、AWS、Apple、Microsoftなどとのサイバーセキュリティ提携の一環として、新しいAIモデル「Project Glasswing」を発表しました。このモデルは、人間による介入をほぼゼロに抑えながら、大規模企業や政府機関のシステムにおける脆弱性を特定することを目的としています。

セキュリティロボティクス企業AsylonとAIエージェント駆動プラットフォームThrive Logicが提携し、エンタープライズ境界セキュリティにフィジカルAIを導入します。自律的な境界パトロールとエージェント型AI分析を組み合わせることで、ネットワークエッジセキュリティの強化を目指します。

オープンテキストの調査によると、日本企業の生成AI導入率は80%と世界平均を大幅に上回る一方、AI投資の費用対効果を実証できる企業は35%に留まっています。この結果は、AI導入後の効果測定体制の強化が日本の企業にとって喫緊の課題であることを示唆しています。

話題のAIエージェントツール「OpenClaw」に重大な脆弱性が発見されました。この脆弱性により、攻撃者はユーザーの認証なしに管理者権限を密かに取得できる可能性があり、ツールを利用するユーザーのセキュリティに対する懸念を一層高めています。

AIが「意思決定し行動する主体」へと進化する中、企業セキュリティは追いついておらず、暴走や乗っ取りといった新たなリスクに直面している。従来の対策では対応できないAIエージェント特有のリスクと、その本質について解説する。

ClaudeのChrome拡張機能に、「ShadowPrompt」というAI不正操作の脆弱性が発見されました。これは設計上の不備とXSS攻撃が組み合わさったもので、閲覧しただけでAIが乗っ取られる可能性があります。

Ringが新しいアプリストアを導入し、AIを活用して提供サービスを拡大します。これにより、従来のホームセキュリティだけでなく、高齢者介護やビジネスニーズなど、より幅広い用途に対応できるようになる見込みです。Ringは、多様な顧客層へのアプローチを目指しています。

Conntourは、AIモデルを活用してセキュリティチームが自然言語でカメラ映像を検索できるシステムを開発しています。これにより、特定の物体、人物、または状況を簡単に特定できるようになります。

データAI企業Databricksは、最近の50億ドルの資金調達により潤沢な資金力を背景に、AIセキュリティ製品の基盤を強化するため、AntimatterとSiftD.aiの2社のスタートアップを買収しました。同社は今後もさらなる買収を検討しています。

AIの導入における最大の障壁はセキュリティリスクであり、データに基づいたAIの価値向上には、モデル構築やトレーニングにおけるセキュリティ対策が不可欠です。特に、量子コンピューティングの脅威が高まる未来に向けて、AIシステムのセキュリティ強化が急務とされています。

先週、Meta社でAIエージェントが不正確な技術アドバイスを与えたため、従業員が約2時間にわたり会社およびユーザーデータに無許可アクセスする事態が発生しました。Metaの広報担当者は、このインシデント中にユーザーデータが誤って処理されることはなかったと述べています。

Linux Foundationは、Anthropic、AWS、GitHub、Google、Google DeepMind、Microsoft、OpenAIから総額1250万ドル(約20億円)の助成金を受領した。この資金は、「Alpha-Omega」等を通じ、AIによる脆弱性報告の急増に直面するオープンソース保守担当者の支援に充てられる。

Nvidiaは、人気のOpenClawを基盤とした、オープンな企業向けAIエージェントプラットフォーム「NemoClaw」を発表しました。

Googleは、クラウド・AIセキュリティ企業Wizを320億ドルで買収完了した。WizはGoogle Cloud部門に統合されるが、ブランドは維持され、マルチクラウド環境へのサービス提供も継続する。Wizの専門知識とGoogleのAI技術を融合させ、サイバー攻撃への対応迅速化と運用コスト削減を目指す。

AIによる議事録作成が進む中、情報漏洩や誤認識のリスクが懸念され、企業はセキュリティ対策を重視している。この記事では、AI議事録活用におけるこうした不安を解消するため、情報漏洩リスクを最小限に抑える具体的な対策が紹介されている。