AIセキュリティ・脆弱性の最新ニュースまとめ

このページでわかること

- AIセキュリティ・脆弱性 関連の国内・海外の直近ニュース 88 件を集約

- 最新から時系列順に並び、難易度バッジ付きで読みたいレベルを選べる

- 国内メディア(ITmedia / AINOW / GIGAZINE 等)と海外メディア(TechCrunch / The Verge 等)を横断

- 毎時自動更新、Gemini による日本語要約とCTR最適化済タイトル

AIモデル・拡張機能の脆弱性やセキュリティ事故まとめ

88件の記事

Claude CodeのAgent toolを用いた並列エージェント活用法を解説。SEO監査やセキュリティ監査など、複数のタスクを同時に実行し作業速度を2倍にするテクニックを紹介します。機能の仕組みや適したタスク、実用例を網羅しました。

Check PointがAIインフラ向けのセキュリティ指針「AI Factory Security Blueprint」を発表。プライベートAI環境においてハードウェアからアプリ層までを保護する統合アーキテクチャを提示します。

AIコーディングアシスタントの利用が広がる中で、生成されたコードに混入するセキュリティ脆弱性のリスクを解説。データに基づき、開発者が注意すべき脆弱性パターンと対策を整理する。

表計算AI「Sheets AI」に、ユーザーの同意なく機密財務データが外部へ送信される脆弱性が見つかりました。PromptArmorが発見し、運営元Ramp Labsは3月16日に修正を完了しました。

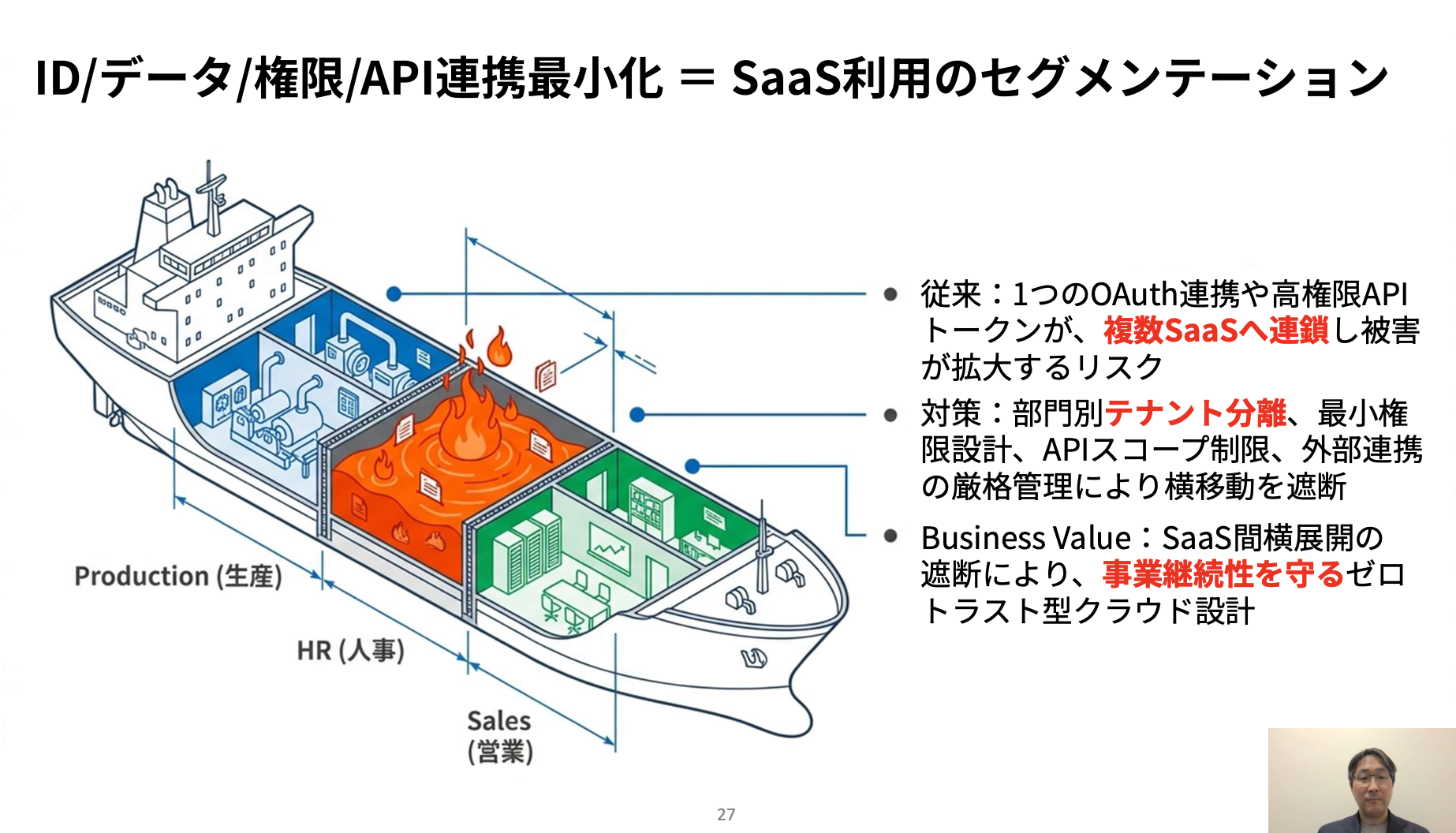

2026年3月4日開催の「ITmedia Security Week 2026 冬」にて、名古屋工業大学の佐々木弘志氏が「AI時代のクラウド活用とレジリエンスの実現」をテーマに特別講演を行いました。

Microsoftが公開した「Digital Defense Report 2025」では、最新のサイバー攻撃手法や国家関与の脅威、AIの悪用リスクを分析しています。組織が直面するセキュリティ課題に対し、防御力を高めるために取り組むべき10の重要事項を提言しています。

Claude Code利用時のセキュリティリスクと対策を解説。誤ったAPI利用による高額課金トラブルなどを例に挙げ、安全にAIコーディングを行うために導入すべきセキュリティキットを紹介します。

AI利用時におけるセキュリティ設計として「AI Gateway」の重要性を提唱。外部モデルAPI利用時のリスク制御と、適切な設計思想について整理したセキュリティガイド。

IT業界、特にサイバーセキュリティ分野の資格取得を目指す若手に向けた包括的なロードマップを紹介。多様な団体から発行される無数の資格を整理し、キャリアパスを俯瞰するための指標として活用できる情報を提供します。

UoWパターンについてAIと記事を書く中で、AI活用技術の未来に対する見解や批判を再考するエッセイ。AIへの依存と自身の推敲プロセスの重要性を論じる。

AWS Security Agentのペネトレーションテスト機能を用いた脆弱性診断の実践ガイド。FastAPIアプリを対象に、設計レビューからコードレビュー、侵入テストまでの流れをCloudFormationテンプレートと共に解説します。

Snowflakeが2026年前半に強化したデータ基盤の方向性を解説。AI運用のコスト・安全管理を担うCortex AI機能群や、Iceberg対応などのオープン化施策をまとめる。

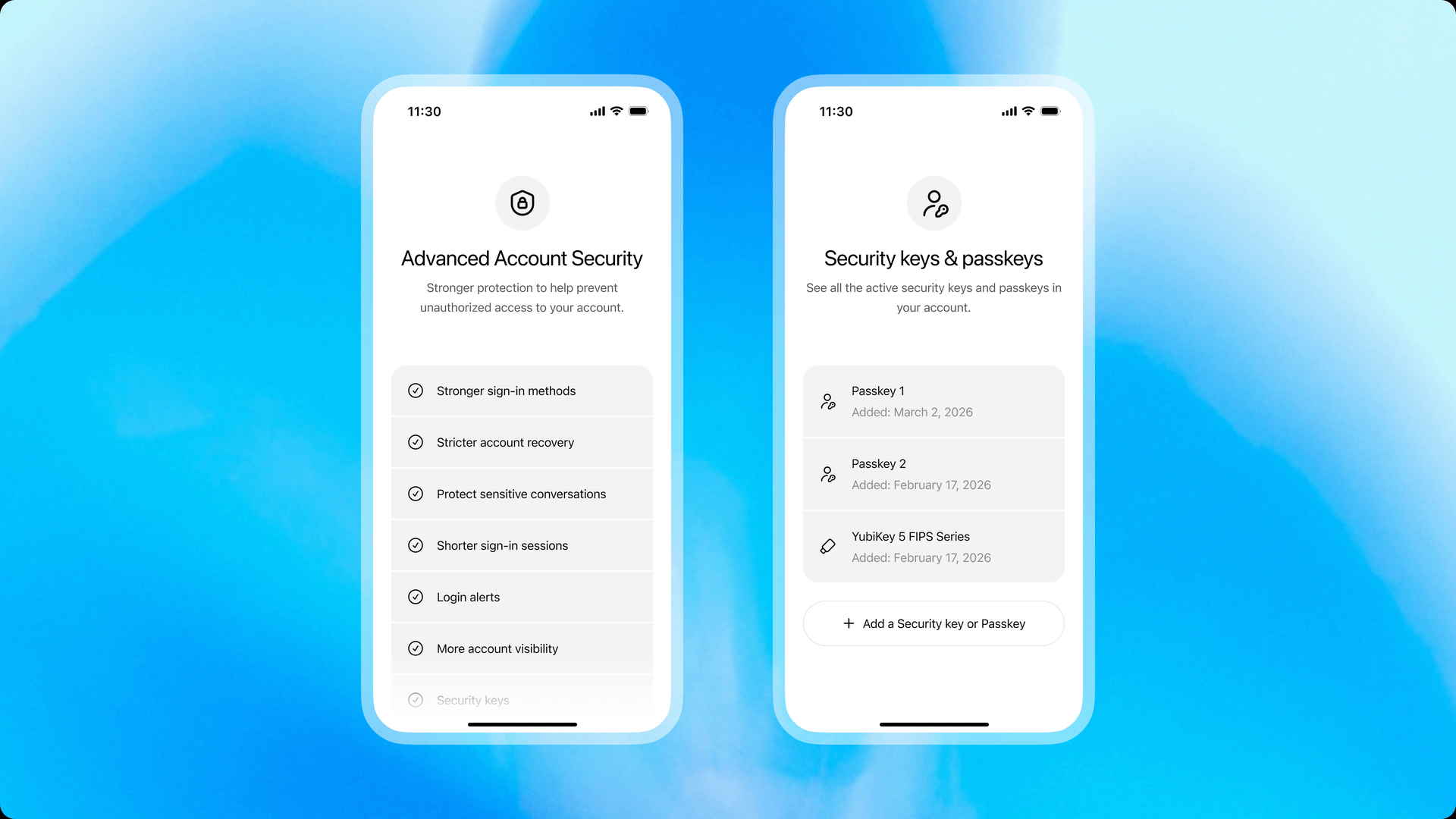

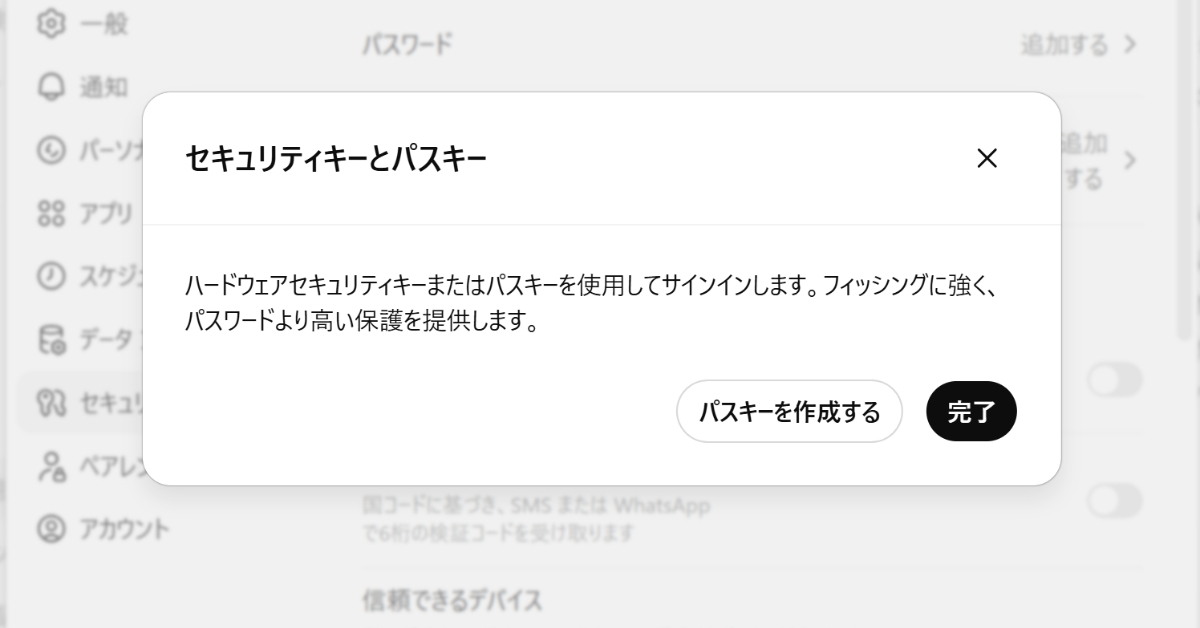

OpenAIは、ChatGPTのアカウントをデジタル攻撃から守るための新機能「高度なアカウントセキュリティ」を発表しました。オプトイン設定でセキュリティを強化できます。

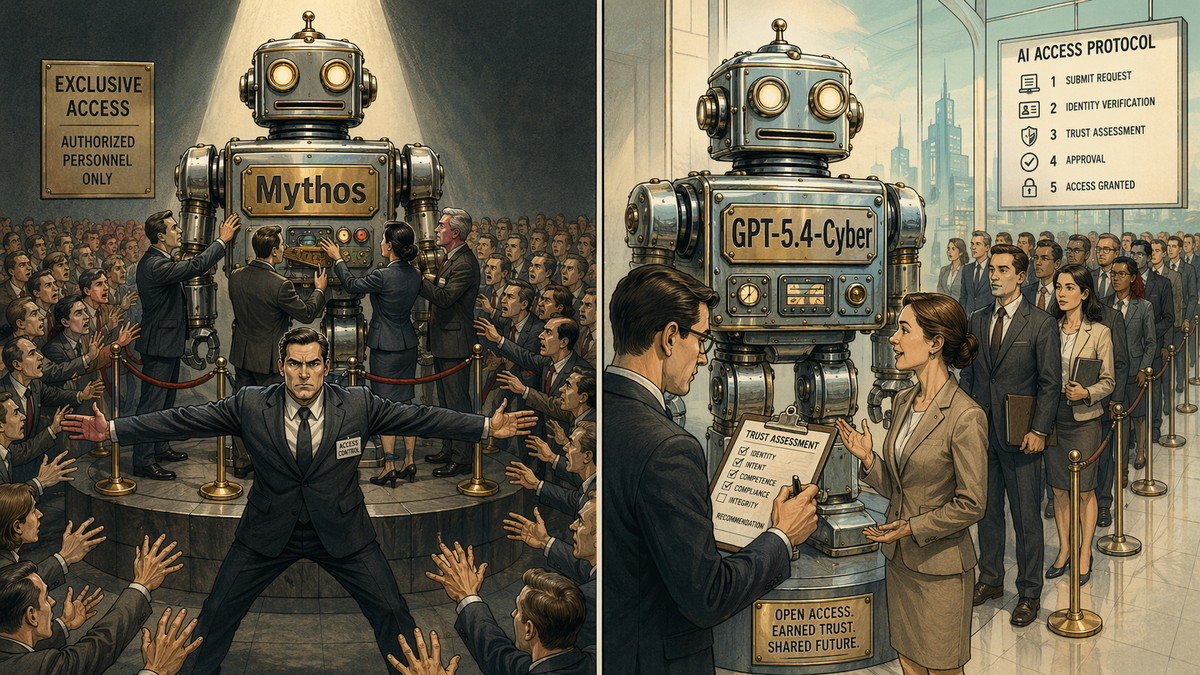

Anthropicの「Claude Mythos Preview」とOpenAIの「GPT-5.4-Cyber」を、サイバーセキュリティの視点から比較検証。両モデルの特性とリスク管理のポイントを解説します。

OpenAIがChatGPT向けに強化版認証機能を提供開始。パスキー対応でセキュリティが向上し、設定により学習対象からも除外可能に。Yubicoとの連携で認証も強化されます。

AI解析ツール「Xint Code」が、Linuxカーネルの暗号化機能に深刻な脆弱性「Copy Fail」を発見しました。一般ユーザーからroot権限を取得可能な危険な欠陥であり、Linuxシステムを利用する環境での警戒が必要です。

OpenAIはChatGPTのセキュリティを強化するため、新しい保護機能の導入を発表。セキュリティキープロバイダーのYubicoと提携し、アカウント保護の選択肢を拡充する。

米Anthropicがセキュリティ特化型AI「Claude Security」のパブリックβ版を公開しました。AIがソースコードをスキャンして脆弱性を自動検出し、そのまま修正まで支援できるため、開発者のセキュリティ対策負担を大幅に軽減します。

OpenAIが発表したサイバーセキュリティ特化型モデル「GPT-5.5-Cyber」は、一般公開されません。まずは信頼された重要防衛機関に限定提供され、組織の防御能力を強化することを目指します。公開時期は段階的に調整される予定です。

マイクロソフトのサティア・ナデラCEOは、OpenAIとの新たな契約により、追加コストなしで同社の技術をクラウド顧客に提供できることを強調しました。ナデラ氏はこれを「最大限に活用する」と述べ、AI覇権に向けた強気の姿勢を見せています。

なぜ最近のサプライチェーン攻撃において、Checkmarx社やBitwarden社のようなセキュリティ企業がターゲットにされたのか。業界全体が直面している脆弱性と、その背景にある攻撃者の狙いを考察します。

GitHubは先月、社内インフラに発見された深刻なリモートコード実行の脆弱性を6時間以内に修正しました。この脆弱性はWiz ResearchがAIモデルを用いて特定したもので、悪用されれば数百万ものコードリポジトリへの不正アクセスを許す可能性がありました。

SIEMの基本的な概念と役割を解説。導入を検討する企業に向けて、自社の規模に適しているかの判断基準や、中小企業が現実的に選択できるセキュリティ対策について整理する。

AIツール利用時の情報漏洩リスクに関するレポートが公開されました。実在する8つのセキュリティ事故事例を挙げ、AI導入時に注意すべき情報の抜き取りやセキュリティ対策の重要性を警告しています。

AI脆弱性診断ツール「Mythos」に関するホワイトペーパーが公開されました。AIを活用したセキュリティ診断の現状や、企業が内製化を判断するための基準を詳しく解説しています。

AIによる自動コーディング(バイブコーディング)の普及に伴い、企業が直面するセキュリティリスクが浮上しています。コード生成AIの誤用や脆弱性混入を防ぐため、企業が講じるべき具体的なガバナンスと対応策を解説します。

Claude Code使用時に設定ファイルへAPIキー等の機密情報が自動記録され、npm公開時に流出するリスクが判明。開発者が陥りがちな見落としの仕組みと、安全なコード管理方法について警鐘を鳴らす。

生成AIを社内導入する際に直面しやすい7つの課題と失敗事例を解説。情報漏洩や誤情報の流布、ツールが定着しないといったトラブルを未然に防ぐための具体的な対策をまとめました。導入担当者が事前に知っておくべきリスクと、成功のためのヒントを提示します。

AIプロジェクトにおける「生のセッションログ」を公開する試み。AIがプロジェクト全体をどのように把握し、人間とどのような粒度で指示をやり取りして実装に至ったかという、AI開発のリアルな思考プロセスを共有するための解説ログ。

AIコーディングにおける情報漏洩リスクを解説し、次世代IDE「Verantyx」が採用する、機密コードを守りつつ高性能LLMを活用するためのGatekeeperアーキテクチャとその実装手法を紹介します。

大手企業の8割以上が、AIやセキュリティ領域における高度IT人材の不足に深刻な懸念を抱いています。デジタル化が進む中で人材の争奪戦が激化しており、企業は採用と育成の両面で喫緊の課題に直面しています。

LayerXが初のM&Aとしてセキュリティ企業AgenticSecを買収しました。AIエージェントによるペンテスト自動化技術を取り入れ、同社はセキュリティ領域へ本格参入します。

AI導入を成功させるには、単発のソリューション導入ではなく、セキュリティを組み込んだ堅牢なアーキテクチャの構築が不可欠です。AIを独立した部品ではなくシステムの一部として管理する重要性を解説します。

セキュリティ認証企業Delveが、セキュリティ事故を公表したAIスタートアップContext AIの認証を担当していたことが判明しました。Delveを巡っては以前から懸念が示されており、今回さらなる問題が露呈した形となります。

AIの業務活用を始めたばかりの新入社員「ニイジマ」が、社内環境でAI利用の失敗(地雷)を繰り返すストーリーを通じて、ビジネス現場で安全かつ効果的に生成AIを扱うための基礎知識とマナーを紹介する入門コンテンツ。

AnthropicのMCPに任意のコマンドが実行される設計上の脆弱性が発見されました。影響範囲が1億5000万件超と非常に大きいため、開発者やシステム管理者は早急な確認と対応が求められます。脆弱性の内容と詳細を確認しましょう。

Anthropicの脆弱性発見AI「Mythos」が複数の米政府機関に導入される一方、中心的な役割を担うCISAがアクセス権を得ていないことが判明しました。この意外な状況が専門家の間で注目を集めています。

自動化されたAIによる脆弱性発見技術が、セキュリティ対策の常識を変えようとしています。かつては攻撃コストを上げることで防御していましたが、AIによって脆弱性をゼロにする目標が現実味を帯びています。企業は従来のコスト構造を見直し、AIを活用したプロアクティブな防御戦略への転換が求められています。

スケジュール管理ツールのCal.comが、AIによるコード解析リスクを懸念しオープンソースからクローズドソースへ移行しました。これに対し、開発コミュニティからは強い反発の声が上がっており、セキュリティとオープンソースのあり方を巡る議論が再燃しています。

Anthropicの未公開AIモデル「Claude Mythos Preview」に、一部の不正ユーザーがアクセスしたことが報じられました。同モデルは「Project Glasswing」の一環として限定公開されていたもので、Anthropic社は現在事態を調査中としています。

CrowdStrikeの最新レポートによると、AIを悪用したサイバー攻撃が前年比89%増加しました。偵察や認証情報窃取、検知回避など、AIが武器化する脅威の現状が浮き彫りになっています。

Anthropicが開発した脆弱性発見特化型AI「Mythos」が、Firefox 150で271件の脆弱性を特定しました。悪用の危険性を考慮し、現在は一部企業のみに限定公開されています。

OpenAIのCEOサム・アルトマン氏が、ポッドキャストに出演し、競合Anthropic社のサイバーセキュリティモデル「Mythos」を酷評しました。製品の優位性を誇張するために恐怖心を煽る手法をとっていると指摘しています。

Anthropic社の最新モデル「Claude Mythos」について解説。本来はプログラミング特化型として設計されたモデルですが、その論理的思考能力の高さからサイバーセキュリティ領域での活用が注目されています。

AIの普及によりセキュリティの前提が変化する中、CSAらが共同発表した「AI Vulnerability Storm」の戦略ブリーフィングについて概説。AI時代のセキュリティ指針を提示。

Akamaiの「インターネットの現状」レポートが、AI時代の新たなサイバー脅威を警告している。AI活用による攻撃手法の高度化に加え、APIが格好の標的となっている実態が浮き彫りになった。また、AI生成コードの脆弱性を突く「バイブコーディング」のリスクも指摘されており、企業には多角的なセキュリティ対策が求められている。