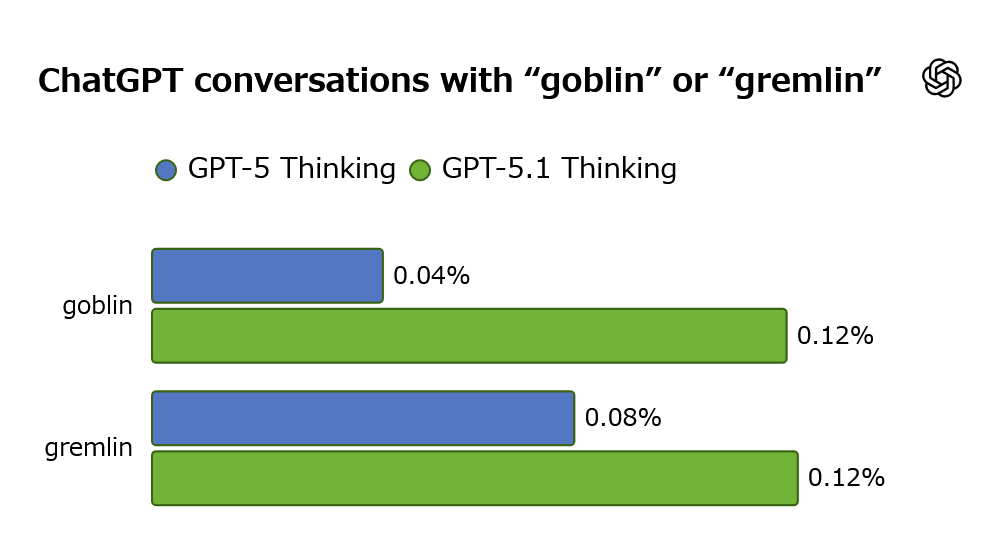

OpenAIのツールでAIが突然「ゴブリン」について言及し続ける不具合が発生しました。原因はシステムの指示文にあったとされ、OpenAIが調査結果を報告しました。

ChatGPTやCodexが「ゴブリン」を連呼するようになった原因をOpenAIが解説、オタクっぽいしゃべり方の学習方法に問題があった

編集メモ: AIモデルの不自然な挙動はシステム指示や学習データの影響を受ける可能性があるため、業務利用時にはAIが意図せぬバイアスや不適切な応答を生成するリスクを念頭に置くべきです。